L’Intelligence Artificielle (IA) est accessible à tous et ChatGPT ou Midjourney font désormais partie de notre quotidien. L’IA est un outil judicieux pour l’automatisation des tâches redondantes et facilite le développement créatif. Mais bien que l’IA soit un outil formidable, elle reste difficile à définir. Surtout, l’IA ne doit pas être assimilée à une forme d’intelligence capable de comprendre comme un humain[i]. La Résolution du Parlement européen du 20 octobre 2020 contenant des recommandations à la Commission concernant un cadre pour les aspects éthiques de l’intelligence artificielle, de la robotique et des technologies connexes, propose une définition de ce qu’on entend par IA[ii]. Selon l’art. 4 a de cette Résolution, l’IA est « un système qui est soit fondé sur des logiciels, soit intégré dans des dispositifs matériels, et qui fait preuve d’un comportement intelligent, notamment en collectant et traitant des données, en analysant et en interprétant son environnement et en prenant des mesures, avec un certain degré d’autonomie, pour atteindre des objectifs spécifiques ». Cette définition clarifie que l’IA fonctionne comme un logiciel ou un dispositif matériel. Son rôle est de collecter et d’analyser des données dans un environnement spécifique, agissant avec un certain degré d’autonomie.

Aujourd’hui, l’IA est capable de créer de faux visages à partir de portraits photographiques. Il suffit de se rendre sur le site internet « thispersondoesnotexist.com » (This Person does not exist) pour le constater[iii]. À chaque rafraîchissement de la page internet, un visage d’une personne qui n’existe pas est généré. L’IA, responsable de la création des faux visages, fonctionne par un mécanisme simple à comprendre. Une grande quantité d’images de visages réels sont insérées dans l’algorithme de l’IA (données input) pour que celle-ci s’entraîne et génère de faux visages (résultat output)[iv]. Ainsi, en nourrissant l’IA par des images, les visages générés seront toujours plus convaincants et réalistes.

Apparu en 2019, This person does not exist a été conçu par un ancien ingénieur d’Uber, Phillip Wang[v]. Ce dernier a repris le code du Style Generative Adversarial Networks (StyleGAN) et la base de données de visages humains que les chercheurs de la société Nvidia ont publiés et mis en libre accès [vi]. La principale motivation des chercheurs dans la création du StyleGAN était d’améliorer la qualité des images jugée insatisfaisante par d’autres modèles IA (cf. infra, Annexe 1) alors que Micheal Wang a conçu This person does not exixst pour que le public soit informé et avertit de l’impact de cette technologie[vii].

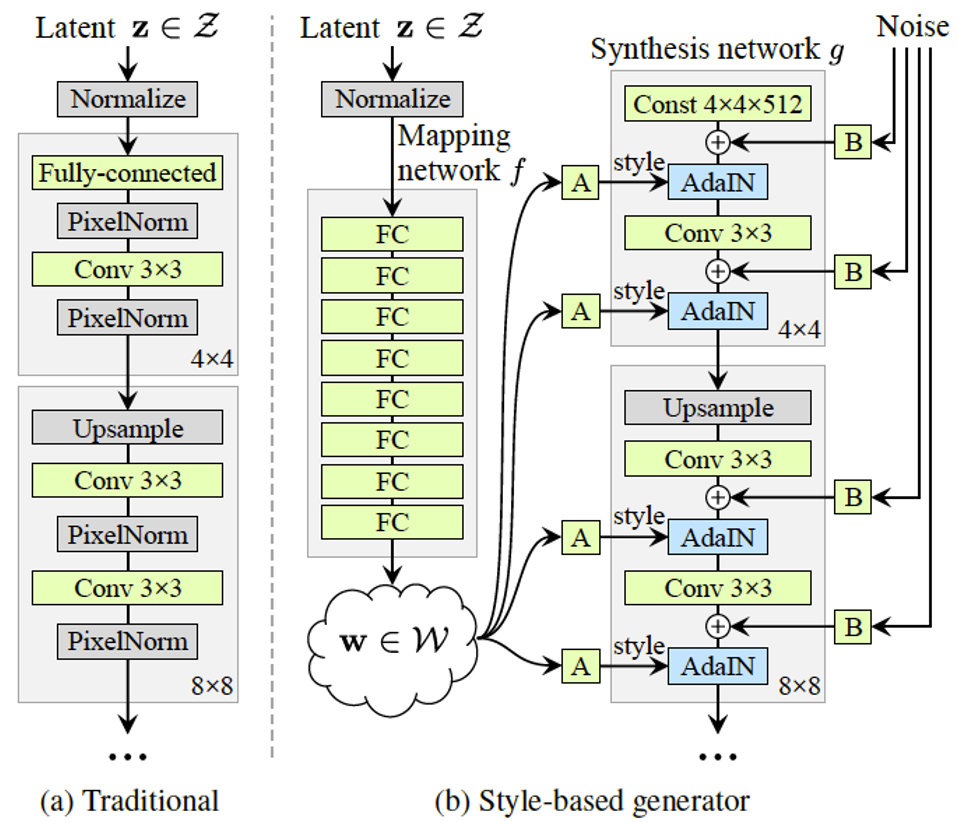

Le modèle d’architecture du StyleGAN peut se décrire brièvement comme suit (cf. infra, Annexe 2): la base du modèle StyleGAN contient un Generative Adversarial Network (GAN), mentionné Synthesis network[viii]. Le GAN contient deux réseaux : un générateur et un discriminateur (cf. infra, Annexe 3)[ix]. Le générateur apprend à générer des faux visages à partir d’une constante mathématique d’une image de visage en basse résolution (4×4). Le rôle du discriminateur est de différencier les vrais ou les faux visages créent par le générateur, en les comparant à des vrais visages humains. Progressivement, le générateur sera nourri d’images de plus grandes résolutions et jusqu’à 1024×1024 afin d’apprendre à générer un visage de haute qualité. Le générateur et le discriminateur seront donc en compétition constante afin de créer un visage le plus réaliste possible. Le vecteur mathématique « Style » issue du « mapping network » permet, en outre, de modifier la résolution des visages dans le générateur. Enfin, l’ajout d’un dernier vecteur mathématique « Noise » stabilisera l’image crée par le générateur.

Pour former le générateur du StyleGAN, les chercheurs de Nvidia ont collecté 70’000 images PNG d’une résolution de 1024×1024 sur « www.flickr.com » (Flickr) afin que le StyleGAN fonctionne de manière optimale[x]. Les 70’000 images sont des portraits photographiques de personnes représentant une diversité complète en termes d’âges et d’ethnicités. Elles incluent, également, des individus portant des lunettes, des chapeaux ou d’autres accessoires. Seules les images libres au téléchargement et à la modification ont été collectées. Divers filtres automatiques ont été utilisés pour modifier l’arrière-plan de la photo. Enfin, Amazon Mechanical Turk a été employé pour supprimer les statues, peintures ou des photos dans les images collectées.

Certes, la technologie du StyleGAN est exceptionnelle pour le processus créatif et la recherche scientifique. Les traitements des photographies par les chercheurs de Nvidia ne sont pas, cependant, conformes au regard la loi fédérale du 25 septembre 2020 sur la protection des données (LPD) et en droit civil[xi]. En effet, le visage humain est un fondement essentiel de la personnalité humaine que le système juridique protège. Utiliser des visages humains pour alimenter l’IA demande à respecter un cadre juridique.

La thématique suivante : « Générateur de visages crée par l’intelligence artificielle : analyse en droit suisse de la protection des données personnelles et en droit civil » a, justement, pour but d’analyser le traitement des données personnelles par Nvidia. Ce travail se concentrera sur la technologie StyleGAN développée par Nvidia ; nous excluons donc, d’autres modèles informatiques qui permettent de générer de faux visages[xii]. Ce mémoire défend que la LPD et le droit civil suisse offrent une protection suffisante pour les photos de nos visages, exception faite des visages de personnes décédées.

Nous effectuerons dans un premier temps, une analyse des traitements de Nvidia au regard de la LPD (I). Dans une deuxième partie, nous établirons les atteintes en droit de la personnalité (art. 28 CC) dans une deuxième partie (II). Enfin, nous examinerons si le droit successoral octroie des droits sur les photos des personnes décédées (III).

I. Préserver l’intégrité des visages en droit de la protection des données

Cette première partie est consacrée aux traitements des photographies Flickr par Nvidia sous la LPD. Afin d’établir une responsabilité de Nvidia sur les traitements des images, il est nécessaire de vérifier, si les photographies sont des données personnelles (cf. infra, I A), d’examiner si les champs d’application personnel et territorial sont respectés (cf. infra, I B) et de contrôler si un ou plusieurs principes de la LPD ont été violés (cf. infra, I C). Nous évaluerons, également, les droits des personnes concernées (cf. infra, I D). Enfin, nous résumerons toutes les considérations dans une synthèse (cf. infra, I E).

A. Qualification des visages comme données personnelles et leurs traitements par Nvidia

En premier lieu, nous examinons, si les photographies utilisées par Nvidia sont des données personnelles et dans un deuxième temps si elles peuvent être qualifiées de données personnelles sensibles.

1. Données personnelles et obstacles à l’anonymisation des visages (art. 5 let. a LPD)

À teneur de l’art. 5 let. a LPD, les données personnelles sont « toutes les informations concernant une personne physique identifiée ou identifiable ». En d’autres termes, ce sont toutes les informations qui permettent d’identifier ou de reconnaître une personne spécifique[xiii]. Une donnée que l’on appelle « identifiée » permet de reconnaître directement la personne du seul fait que la donnée lui est propre[xiv]. Par exemple, le contenu de la carte d’identité à savoir le nom, le prénom et le visage, constitue des données permettant l’identification directe. En revanche, une personne sera « identifiable » par une corrélation d’informations en fonction des circonstances ou du contexte[xv]. Ce sont, notamment, les caractéristiques physiques d’une personne, son ADN, ses données de localisations ou un numéro d’identification[xvi]. L’identité d’un propriétaire pouvant être déterminée à partir d’informations sur ses biens-fonds en est un exemple[xvii].

De plus, il est possible d’anonymiser ou de « pseudonymiser » les données pour que ces dernières ne soient pas reconnaissables ou identifiables. En faisant cela, les données échappent à l’application de la LPD[xviii]. Une donnée est anonymisée lorsque la référence à la personne est supprimée de manière irréversible et qu’il n’est plus possible de remonter jusqu’à elle sans effort disproportionné[xix]. D’un autre côté, la « pseudonymisation » code les données personnelles afin qu’elles soient uniquement identifiables par une clé de décodage[xx].

La jurisprudence a jugé qu’une photographie ou un enregistrement d’un visage est une donnée personnelle en raison de son caractère reconnaissable ou identifiable (art. 5 let. a LPD)[xxi]. Dans l’arrêt Google Street View, le Tribunal fédéral a confirmé le raisonnement du Tribunal administratif fédéral et a considéré que « les données brutes issues de la prise d’images et n’ayant pas encore été retravaillés de façon automatique ont un caractère de données identifiable »[xxii]. Le Tribunal fédéral ajoute que « même lorsque le visage a été flouté à l’aide d’un logiciel d’anonymisation, une personne peut tout à fait être identifiée selon diverses circonstances : lieu de la prise de vue, situation concrète, vêtements et comportements »[xxiii]. En d’autres mots, même une anonymisation d’un visage par un floutage ne rend pas la donnée anonymisée. Dans une autre affaire, le Tribunal fédéral a jugé que « les images enregistrées par un dispositif de vidéosurveillance permettent d’identifier des personnes déterminées et sont donc des données personnelles »[xxiv].

Afin d’alimenter la base de données, les chercheurs de Nvidia ont sélectionné 70’000 images de personnes à l’état brut et les ont placés dans des dossiers Google drive accessible publiquement[xxv]. Certaines de ces images présentent des personnes connues comme Barack Obama, ancien président des États-Unis, et sont donc tout à fait reconnaissables ou identifiables (cf. infra, Annexe 4)[xxvi]. Avant d’être insérées dans le StyleGAN, les images ont été recadrées et filtrées afin de retirer des éléments d’arrière-plan extérieur comme des statues, peintures ou photos[xxvii]. À première vue, cet effort permet au résultat output du StyleGAN de rendre les images générées comme anonymes. Toutefois, ces efforts ne changent pas le fait que les visages input soient utilisés dans le générateur du StyleGAN, ce qui rend l’identification ou la reconnaissabilité toujours possible.

En définitive, les photographies collectées par Nvidia sont bien des données personnelles.

2. Les photographies comme données personnelles sensibles (art. 5 let. c LPD)

Réglementé à l’art. 5 let. c LPD, les données personnelles sensibles sont une catégorie spéciale des données personnelles. Certaines données sont particulièrement liées à la personnalité d’une personne et leur traitement génère un risque important[xxviii]. Les données sensibles les plus pertinentes pour notre analyse sont : les données biométriques identifiant une personne physique de manière univoque (art. 5 let. c ch. 4 LPD), les données sur les opinions ou les activités religieuses, philosophiques politiques ou syndicales (art. 5 let. c ch. 1 LPD) ainsi que les données sur la santé, la sphère intime ou l’origine raciale ou ethnique (art. 5 let. c ch. 2 LPD).

Selon le Conseil fédéral, les données biométriques sont toutes les données personnelles résultat d’un traitement technique spécifique. Elles sont relatives aux caractéristiques physiques, physiologiques ou comportementales d’une personne physique qui permettent ou confirment son identification unique[xxix]. À titre d’exemple nous pouvons citer, les empreintes digitales, les images faciales, l’iris et la voix sont des données biométriques[xxx].

Les photographies de personnes peuvent-elles être qualifiées de données biométriques ? Cette question pose des difficultés pratiques[xxxi]. En effet, si toutes les photographies humaines devaient être considérées comme des données sensibles (art. 5 let. c LPD), d’autres exigences complémentaires à la LPD seraient imposées au responsable de traitement[xxxii]. Ce dernier devra, notamment, veiller à ce que le consentement des personnes concernées soit obtenu de manière exprès (art. 6 al. 7 ch. 1 let. a LPD). En principe, les photographies de visages ne revêtent pas forcément pas un caractère de données biométriques[xxxiii]. Selon le Rapport d’accompagnement de l’AP-LPD, les photographies peuvent être qualifiées de données biométriques que « lorsqu’elles sont traitées par un moyen technique spécifique permettant l’identification ou l’authentification unique d’un individu »[xxxiv]. Autrement dit, afin qu’une photographie puisse être reconnue comme une donnée biométrique, un moyen technique doit permettre d’identifier le visage d’une personne sans ambiguïté[xxxv].

La qualité de donnée biométrique a été accordée aux données utilisées pour effectuer de la reconnaissance faciale par la société Clearview AI[xxxvi]. Le logiciel de Clearview AI collecte et ajoute à une base de données des photographies, des vidéos en libre accès de personnes[xxxvii]. Des données biométriques sont extraites des photographies afin d’effectuer une recherche par images et d’identifier une personne[xxxviii]. Les données biométriques collectées par Clearview AI, forment ainsi un gabarit biométrique. La collecte des photographies, tout comme la constitution d’un gabarit biométrique de Clearview AI sont jugées contraire au Règlement 2016/679 Parlement Européen et du Conseil, du 27 avril 2016, relatif à la protection des personnes physiques à l’égard du traitement des données à caractère personnel et à la libre circulation de ces données, et abrogeant la directive 95/46/CE (RGPD) par la Commission nationale de l’informatique et des libertés (CNIL). Cette dernière a constaté que la constitution d’un gabarit biométrique à partir d’un visage correspond à un traitement biométrique, car il est lié à notre identité physique et permet une identification unique[xxxix].

Qu’en est-il des photographies collectées par Nvidia ? Au premier abord, il peut être soutenu que les photographies collectées sur Flickr ne sont pas des données biométriques. En effet, elles n’identifient pas clairement des personnes. En outre, le StyleGAN n’identifie pas non plus une personne spécifique ou ne cherche pas une authentification unique d’un individu. Son fonctionnement vise à utiliser, à mélanger les caractéristiques des visages, ce qui rend l’identification ou l’authentification unique d’un individu difficile. Cependant, recadrer et isoler les visages dans les photographies ainsi qu’éliminer les arrière-plans correspond à un moyen technique avancé. Comme dans le cas précipité de Clearview IA, les visages extraits des photos, par le StyleGAN, permettent de construire un gabarit biométrique d’une personne. Les visages ainsi obtenus peuvent potentiellement servir à un logiciel de reconnaissance faciale. C’est par cette modification des photographies Flickr que Nvidia a créée des gabarits numériques. Ainsi, les photographies modifiées sont des données biométriques, soit des données personnelles sensibles (art. 5 let. c ch. 4 LPD).

En plus d’être considérées, potentiellement, comme des données biométriques, les photographiques peuvent révéler d’autres informations sensibles. Il n’est pas rare que des photos expriment des opinions ou des activités religieuses, philosophiques, politiques ou syndicales (art. 5 let. c ch. 1 LPD). Elles peuvent également révéler des informations sur la santé, la sphère intime, l’origine raciale ou ethnique (art. 5 let. c ch. 2 LPD). Meier estime que des photos contenant des informations présentent dans l’art. 5 let. c ch. 1et 2 LPD ne seraient pas initialement considérés comme données sensibles et il faut considérer le contexte dans lequel elles sont utilisées[xl]. Cela fait penser à l’arrêt Google Street View où le Tribunal fédéral a confirmé la demande du Préposé fédéral à la protection des données et à la transparence (PFPDT) à savoir anonymiser les images de personnes circulant à proximité des hôpitaux, portant des signes distinctifs tels que la couleur de peau, les habits ou appareils de personnes souffrant de handicap physique[xli]. Par raisonnement analogique, la capture de ce genre d’images communique des informations suffisamment importantes sur une personne pour les considérer comme des données sensibles au sens de l’art. 5 let. c ch. 1 et 2 LPD.

Parmi les 70’0000 photographies Flickr collectées, d’innombrables informations sur les opinions ou les activités religieuses, philosophiques ou syndicales de personnes peuvent être trouvées. En outre, nous constatons que les photos collectées contiennent des informations sur la santé, la sphère intime ou l’origine raciale ou ethnique de personnes. À titre d’exemple, la base de données contient des photos d’un festival local italien « La notte delle streghe e dei folletti », qui montrent des personnes portant le turban Sikh ou encore une personne se faisant vacciner (cf. infra, Annexe 5)[xlii]. Conformément à la jurisprudence Google Street View, ces types de photographies récoltées par Nvidia constituent des informations sensibles sur les personnes. Ainsi, les photographies collectées doivent être considérées comme des données sensibles au sens de l’art. 5 let. ch. 1 et 2 LPD.

B. Les champs d’applications de la LPD

Dans cette partie, nous vérifions que les champs d’application personnel et territorial de la LPD soient remplis.

1. Champ d’application personnel (art. 2 al. 1 let. a in fine LPD) et traitement des données

Le champ d’application personnel, prévu à l’art. 2 al. 1 let. a LPD, permet d’établir qu’une personne privée sera responsable du traitement des données personnelles[xliii]. Dès que la personne privée seule ou conjointement avec d’autres, détermine les finalités et les moyens du traitement des données personnelles, elle sera considérée comme responsable du traitement (art. 5 let. j LPD). Concernant la notion de traitement, l’art. 5 let. d LPD l’a définie comme « toute opération relative à des données personnelles, quels que soient les moyens et procédés utilisés, notamment la collecte, l’enregistrement, la conservation, l’utilisation, la modification, la communication, l’archivage, l’effacement ou la destruction de données ». Cette définition non-exhaustive vise toute opération sur des données personnelles[xliv].

En tant que société multinationale inscrite et incorporée aux États-Unis, Nvidia est une personne privée[xlv]. Afin de générer les faux visages, Nvidia a procédé à diverses opérations relatives à des données personnelles. En effet, 70’000 images PNG de haute qualité et de résolution 1024 x 1024 ont été collectées sur Flickr[xlvi]. Ces images de visages sont variées en termes d’ethnicité, âge, accessoires vestimentaires ou images de fond[xlvii]. Les images ont été enregistrées et conservée dans des fichiers Google drive public avant de les insérer dans le StyleGAN[xlviii]. Les images ont été également modifiées par l’usage de filtres et de Amazon Mechnical Turk afin d’anonymiser les arrière-plans, les peintures, les sculptures ou les photos présentes dans l’image[xlix]. Toutes ces opérations constituent donc un traitement de données personnelles. En somme, Nvidia est une personne privée et elle responsable du traitement des photographies des utilisateurs Flickr. Le champ d’application personnel de la LPD est donc rempli.

2. Champ d’application territorial (art. 3 al. 1 LPD)

Le champ d’application territorial de la LPD s’applique aux états de fait qui déploient des effets en Suisse, même s’ils se sont produits à l’étranger (art. 3 al. 1 LPD). La jurisprudence Google Street View confirme également qu’une image prise sur le territoire suisse peut constituer une atteinte à la personnalité. Dès lors, il n’importe pas que l’image soit retravaillée et qu’elle ne soit pas en ligne directement depuis la Suisse[l].

En consultant les dossiers Google drive sur lesquels se trouvent les photographies Flickr collectées, nous identifions des photos de personnes en Suisse (cf infra, Annexe 6)[li]. À l’origine, ces photographies proviennent de la société Suisse Tourisme. Les personnes sur les photos posent dans des wagons CFF et tendent des carnets de notes Suisse Tourisme vers la caméra. Bien que les images collectées se trouvent dans des serveurs à l’étranger, leurs exploitations par Nvidia déploient un point de rattachement en Suisse[lii]. Ainsi, le champ d’application territorial est également rempli.

C. Les images récupérées sur Flickr et utilisés comme données d’entraînement

Dans cette partie, nous examinons si Nvidia a violé certains principes de la LPD.

1. Respects des principes de la LPD

La LPD instaure une série de principes que le responsable de traitement doit respecter dès lors qu’un traitement de données est effectué. À défaut, le traitement conduirait à une atteinte à la personnalité en violation des principes définis aux arts 6 et 8 LPD (art. 30 al. 2 let. a LPD).

En collectant et modifiant les photos de Flickr, nous constatons que Nvidia a violé les principes de licéité (art. 6 al. 1 LPD), de transparence (art. 6 al. 2 et al. 3 LPD) et de proportionnalité (art. 6 al. 2 in fine et al. 4 LPD). Ces divers processus de traitements ne sont pas distingués et seront traités ensemble dans les sous-parties suivantes. Le consentement comme principe de la LPD sera traité à la partie (cf. infra, I C 2).

a. Principe de licéité (art. 6 al. 1 LPD)

L’art. 6 al. 1 LPD prévoit que chaque traitement de données personnelles doit être licite. En d’autres termes, un traitement de données ne doit pas être illicite. Il existe une controverse sur la notion de licéité dans le traitement des données personnelles[liii]. Le Tribunal administratif fédéral, interprète que l’art. 6 al. 1 LPD et l’art. 30 al. 1 LPD interdissent de traiter des données en dehors du cadre établit par la LPD ou à l’encontre d’une disposition particulière de la LPD[liv]. Dans cette hypothèse, le responsable de traitement devra examiner d’abord la conformité du traitement au regard de la LPD et en particulier dans ses principes (art. 30 al. 2 let. a LPD)[lv]. Pour une partie de la doctrine, une violation du principe de licéité est admissible lorsque le traitement est contraire à une norme impérative de l’ordre juridique suisse, autre que la LPD[lvi]. Les normes identifiants une violation du principe de licéité peuvent être fédérales, cantonales voir communales comme civiles, pénales ou administratives[lvii]. Il faut aussi que la norme protège directement ou indirectement la personnalité.

Les articles 28 ss CC sont des normes qui protégèrent la personnalité et sont de nature impérative en droit suisse. Une violation des arts 28 ss CC constituera donc une violation du principe de licéité (art. 6 al. 1 LPD). Nous développerons donc notre analyse sur les arts 28 ss CC, ci-dessous (cf. infra, II).

b. Transparence sur les traitements des images (art. 6 al. 2 et al. 3 LPD) et devoir d’information (art. 19 LPD)

Conformément aux principes de la bonne foi (art. 6 al. 2 LPD), de la finalité et de la reconnaissabilité (art. 6 al. 3 LPD) le responsable de traitement doit être transparent sur le sort des données personnelles durant toutes les phases du traitement. Nous allons traiter ensemble les principes de la bonne foi, de la reconnaissabilité et de la finalité pour notre analyse. En effet, les exigences sur la transparence du traitement de ces principes se recoupent entre eux[lviii].

Le principe de la bonne foi de l’art. 6 al. 2 LPD fait directement référence à l’art. 2 CC[lix]. Il faut comprendre ce principe comme une façon d’agir de manière honnête, loyale et digne de confiance dans les affaires[lx]. Dans le cadre de la LPD, la bonne foi demande que le responsable de traitement communique à la personne concernée toutes les informations nécessaires sur le traitement de ses données. Ces exigences sont conformes aux principes de la reconnaissabilité et de la finalité (art. 6 al. 3 LPD) afin que les personnes concernées sachent que leurs données personnelles sont collectées et quelles sont les finalités précises du traitement[lxi]. Par exemple, enregistrer une conversation téléphonique doit être annoncé avant tout début d’enregistrement.

Le Tribunal fédéral a concrétisé la notion de reconnaissabilité et de finalité. Dans l’arrêt Logistep, le responsable de traitement n’a pas fourni d’information concernant la collecte de l’adresse IP de la personne concernée et de son but[lxii]. Ainsi, il n’était pas possible de savoir pour la personne concernée que ses données personnelles seraient enregistrées par des sociétés anti-P2P. De surcroit, le Tribunal fédéral retient, dans l’arrêt Google Street view que les passants circulant sur la voie publique n’étaient pas en mesure de savoir que le véhicule Google Street capturait leurs images, puis qu’elles seraient publiées sur Internet[lxiii]. Une information publiée à l’avance sur internet ne garantit pas de façon suffisante la publicité requise[lxiv].

Ces exigences de transparence sur le traitement des données, instaurent un devoir d’information (art. 19 LPD) que le responsable de traitement doit fournir à la personne concernée[lxv]. En effet, l’art. 19 al. 1 LPD prévoit que « lors d’une collecte de données, le responsable de traitement doit informer la personne concernée de manière adéquate de la collecte de données personnelles que celle-ci soit effectuée auprès d’elle ou non ». Le but de ce devoir d’information est d’établir la confiance sur le traitement des données et que la personne concernée peut faire valoir ses droits sous la LPD[lxvi]. Ainsi, le responsable de traitement doit communiquer à la personne concernée au moins : l’identité et les coordonnées du responsable du traitement (art. 19 al. 2 let. a LPD) ; la finalité du traitement (art. 19 al. 2 let. c LPD) ; le cas échéant, les destinataires ou les catégories de destinataires auxquels des données personnelles sont transmises (art. 19 al. 2 let. c LPD).

Le même devoir d’information s’applique en cas de collecte directe et indirecte auprès de la personne concernée. La collecte directe a lieu lorsque les données sont collectées directement par le responsable de traitement[lxvii]. Tandis que la collecte indirecte a lieu lorsque le responsable de traitement a collecté les données non pas auprès de la personne concernée mais auprès de tiers[lxviii]. « Tiers » signifie que les données obtenues proviennent de sources publiques et librement accessibles, d’entreprises privées ou encore par webtracking[lxix]. Dans le cadre d’une collecte de données indirecte, le responsable de traitement doit communiquer, en plus des informations de l’art. 19 al. 2 LPD, les catégories de données collecté (art. 19 al. 3 LPD)[lxx]. Mettre à disposition des informations sur un site Internet ne suffit pas[lxxi]. Le responsable de traitement doit informer activement la personne concernée[lxxii]. La communication se fait, en outre, dans le mois qui suit l’acquisition des données auprès du tiers (art. 19 al. 5 LPD).

En l’espèce, Nvidia a collecté les photographies, non pas directement auprès des personnes détentrices des photos, mais auprès de Flickr. Cela constitue une collecte de données personnelles indirecte[lxxiii]. Le fait que les utilisateurs ont accordé à leurs photos différents types de licences libres, permet une collecte de données sans devoir d’information et de transparence[lxxiv]. En d’autres termes, Nvidia n’a pas jugé nécessaire d’informer les utilisateurs de Flickr que les visages de leurs photos serviront à entraîner l’IA. Il en ressort un manque de transparence de la part Nvidia et une faille quant au devoir d’information. En effet, les personnes publiant des photos sur Flickr sur lesquelles apparaît leur visage ne savent pas que leurs photos serviront de données d’entraînement à une IA. Tout au plus, Nvidia informe sur sa page « www.github.com » (GitHub) qu’elle respecte la vie privée des utilisateurs de Flickr et qu’il possible de demander la destruction des photos collectées dans la base de données[lxxv]. Toutefois, cette information est communiquée après la collecte de traitement, non pas avant. Ces efforts insuffisants pour admettre une transparence du traitement des données. En somme, ces éléments soutiennent que le devoir de transparence et d’information de Nvidia n’est pas conforme à la LPD.

Reste à examiner si Nvidia peut se prévaloir d’une exception au devoir d’information. L’art. 20 LPD prévoit des exceptions au devoir d’informer pour le responsable de traitement. Pour le cas d’une collecte directe, il suffit que l’une des conditions de l’art. 20 al.1 LPD soit remplie. Lors d’une collecte indirecte, il suffit que l’information soit impossible à donner (art. 20 al. 2 let. a LPD) ou qu’elle nécessite des efforts disproportionnés (art. 20 al. 2 let. b LPD)[lxxvi]. Par « information impossible à donner », on doit comprendre qu’il n’est pas possible d’identifier la personne concernée et que l’impossibilité est totale[lxxvii]. Par « efforts disproportionnés », il doit être compris qu’il serait trop difficile pour le responsable de traitement de retrouver la personne concernée par rapport aux informations disponibles[lxxviii].

Selon nous, Nvidia ne pourra ni plaider que l’information de la collecte est impossible à donner pour les utilisateurs Flickr, ni que cela nécessite des efforts disproportionnés. La cause en est que Nvidia a organisé et mis en accès libre sur Google drive toutes les photos collectées pour nourrir le StyleGAN[lxxix]. En outre, Nvidia a mis en service une plateforme Internet afin qu’un utilisateur Flickr puisse identifier si ses photos ont été collectées[lxxx]. Ces accès et informations prouvent que Nvidia pouvait se conformer au devoir d’information lors de la collecte de photographies sur Flickr. En définitive, l’information était préalablement possible à donner et sans que cela demande des efforts disproportionnés à Nvidia.

Un responsable de traitement peut également restreindre, différer ou même renoncer à la communication des informations si les intérêts prépondérants d’un tiers l’exigent (art. 20 al. 3 let. a LPD) ou que l’information empêche le traitement d’atteindre son but (art. 20 al. 3 let. b LPD). Surtout, si le responsable de traitement est une personne privée, il peut également restreindre, différer ou renoncer de communiquer lorsque ses intérêts prépondérants l’exigent ou qu’il ne communique pas les données à des tiers (art. 20 al. 3 let. c ch. 1 et 2 LPD).

Or il n’existe pas d’intérêt de tiers à ce que la collecte faite par Nvidia ne soit pas dévoilée. Une communication sur la collecte de données n’empêche le traitement puisque les recherches ont été publiées, et n’ont pas été tenues secrètes. De plus, Nvidia n’a pas d’intérêt prépondérant à ce que les informations sur la collecte de données soient tenues secrètes dans le cadre de ses recherches. En effet, Nvidia voulait partager les résultats de ses recherches. Enfin, Nvidia n’a pas communiqué les données à des tiers puisqu’elles sont accessibles, les photographies brutes ou filtrées sont disponibles sur Google Drive. Dès lors, Nvidia ne pouvait restreindre son devoir d’information aux utilisateurs de Flickr.

c. Principe de la proportionnalité (art. 6 al. 2 in fine et al. 4 LPD)

Le principe de proportionnalité (art. 6 al. 2 in fine LPD) demande que le responsable de traitement « collecte et traite que les données qui sont aptes, mais surtout objectivement nécessaires pour atteindre le but poursuivi, pour autant que le traitement demeure dans un rapport raisonnable entre le résultat (légitime) recherché et le moyen utilisé, tout en préservant le plus possible les droits des personnes concernées »[lxxxi]. En d’autres termes, le traitement doit être apte et nécessaire pour atteindre le but désiré. De plus, une pesée d’intérêt doit être faite entre le but du traitement et l’atteinte aux droits des personnes concernées. Cela veut dire qu’une considération des intérêts publics et privés doit être pesée à chaque traitement[lxxxii].Enfin, le principe de proportionnalité est applicable à chaque phase de traitement[lxxxiii]. Il s’effectue de manière objective et en fonction des circonstances concrètes d’un cas d’espèce[lxxxiv].

Un intérêt privé pour la recherche scientifique est susceptible d’être invoqué. Le responsable peut plaider, notamment, qu’il anonymisera les données dès que la finalité du traitement le permet (art. 31 al. 2 let. e ch. 1 LPD par analogie). Si l’anonymisation est impossible ou exige des efforts disproportionnés, le responsable de traitement doit prendre des mesures appropriées afin que les personnes concernées ne soient pas identifiées (art. 31 al. 2 let. e ch. 1 in fine LPD par analogie).

D’après les informations fournies par Nvidia concernant leurs recherches, la récolte de photographies était apte pour que le StyleGAN opère concrètement[lxxxv]. Le but est clairement identifiable car il vise à créer des faux visages humains à partir de photographies réelles. Sans la récolte des 70’000 photos, il ne serait sans doute pas possible de créer des visages aussi réalistes. Il était donc nécessaire que Nvidia récolte une grande quantité de photos que l’on considère sensibles pour générer les faux visages. Quant à la possibilité d’entraîner le StyleGAN par d’autres moyens, les précédentes bases de données contenant de visages n’étaient, ni assez variées ni de qualités[lxxxvi]. Il n’était pas possible de perfectionner le StyleGAN sans une grande quantité de données de bonnes qualités. Ne disposant pas d’une telle base de données, les chercheurs ont trouvé qu’un accès public aux photos leur permettait de collecter et de modifier les photos à leurs volontés. Concernant la pesée des intérêts, nous n’identifions pas d’intérêts publics prépondérants pour les traitements de Nvidia. Un intérêt privé de recherches scientifique peut-être invoqué part de Nvidia, mais cela ne l’emportera pas sur l’intérêt des personnes concernées à ce que leurs images ne soient pas utilisées dans le StyleGAN. Surtout, il n’est pas possible d’anonymiser les visages, ni d’employer d’autres méthodes afin d’assurer l’anonymat des utilisateurs Flickr. Un visage non anonymisable et identifiable est nécessaire pour que le StyleGAN fonctionne de manière efficace. Par conséquent, la proportionnalité, au sens matérielle, n’est pas remplie pour les traitements des données Flickr.

Le principe de proportionnalité exige également que le traitement ait une durée de conservation définie (art. 6 al. 4 LPD)[lxxxvii]. C’est-à-dire que le responsable de traitement devra détruire ou anonymiser les données lorsqu’elles ne sont plus nécessaires à la finalité du traitement. La durée de conservation dépend au cas par cas, mais elle a été fixée à 100 jours concernant des images de vidéosurveillance de lieux publics[lxxxviii]. Sinon, le Préposé fédéral à la protection des données et de la transparence (PFDT) a donné des recommandations de cas où les données peuvent être conservées plus longtemps ou non[lxxxix].

Les personnes concernées peuvent accorder au responsable de traitement une durée de conservation des données plus étendue si c’est prévu dans le contrat[xc]. Cela donnera un motif justificatif à la violation des données personnelles. En revanche, en dehors d’un cadre contractuel, le responsable devra déterminer la durée de conservation en vue des finalités du traitement, du type de données ainsi que l’accès des personnes concernées[xci].

Toujours selon les informations disponibles de Nvidia, il n’existe pas d’indication que Nvidia s’engage à détruire ou anonymiser les données au bout d’un certain temps. Comme nous l’avons conclu (cf. supra, I A 1 et 2), l’anonymisation des visages n’est pas possible car ils sont toujours reconnaissables ou identifiables même après introduit dans le StyleGAN. La « pseudonymisation » n’est pas possible également. Mais il existe un cadre contractuel entre les utilisateurs de Flickr et Nvidia qui est celui d’un contrat de licence. Ci-après, nous analyserons si le consentement obtenu dans le contrat permet à Nvidia de conserver les données indéfiniment.

2. Le consentement des utilisateurs Flickr

a. La notion de consentement (art. 6 al. 6 et al. 7 LPD)

L’art. 6 al. 6 LPD pose les conditions afin d’obtenir le consentement des personnes concernées. Selon cette disposition, « lorsque le consentement de la personne concernée est requis, celle-ci ne consent valablement que si elle exprime librement sa volonté concernant un ou plusieurs traitements déterminés et après avoir été dûment informée ». Le consentement doit être invocable avec des dispositions spécifiques à la LPD[xcii]. Par exemple, à l’art. 31 al. 1 LPD comme motif justificatif. En principe, le consentement doit être donné avant l’atteinte à la personnalité. Si le consentement est donné après l’atteinte, la personne renonce à faire valoir ses droits de la personnalité (art. 32 al 2 LPD ; art. 28a CC)[xciii].

La personne qui donne son consentement doit comprendre parfaitement ce qu’elle est en train d’accepter [xciv]. Le Conseil fédéral a souligné que le responsable de traitement doit fournir les informations contenues à l’art. 19 al.2 LPD, qui sont la finalité du traitement et les coordonnées du responsable du traitement, la finalité du traitement et le cas échéant, les destinataires ou les catégories de destinataires auxquels des données personnelles sont transmises[xcv]. Si les finalités et buts des traitements venaient à changer, le consentement de départ n’est plus valable[xcvi]. Il est important de comprendre aussi qu’un consentement n’est pas indéterminé et que les personnes concernées sont libres de révoquer leurs consentements en tout temps (art. 27 al. 2 CC)[xcvii].

Concernant les données sensibles (art. 6 al. 7 let. a LPD), les personnes concernées doivent pouvoir donner leurs consentements sur leurs traitements par une manifestation claire de volonté. Cela veut dire que le consentement donné ne peut pas être implicite ou tacite. En outre, le consentement devra se reposer sur un comportement actif de la personne concernée[xcviii].

Pour notre cas d’usage, la collecte de données indirectes par Nvidia a été illicite au regard de la LPD. Nvidia peut invoquer que sa collecte de donnée s’est basée sur un consentement au sens de l’art. 31 al. 1 LPD des utilisateurs de Flickr. Selon elle, les images collectées ont été publiées sur Flickr par leurs auteurs respectifs et sous des licences. Ci-dessous (cf. infra, I C 2 b) et (cf. infra, I C 2 c), nous examinons en détail, si les conditions générales d’utilisations de Flickr et les types de licences accordées octroient un consentement (art. 31 al. 1 let. a LPD) pour justifier l’atteinte à la collecte des photos.

b. Les conditions générales d’utilisation et politiques de vie privée sur Flickr

Au préalable, il est nécessaire d’examiner si des conditions générales d’utilisation et la politique de vie privée permettent l’octroi d’un consentement sur le traitement des photos comme données personnelles.

Les conditions générales d’utilisation sont des contrats préformulés qui se caractérisent par une absence de négociations individuelle et par son caractère unilatéral sur l’utilisateur[xcix]. Le but est de surtout de gagner en temps. En effet, ce mécanisme précontractuel chercher à uniformiser les conditions contractuelles entre un prestataire sur internet et les utilisateurs de la plateforme numérique. Pour parvenir à ce gain de temps, les conditions doivent être claires, concrètes, faciles d’accès, reconnaissables et non trompeuses pour les utilisateurs[c]. Un utilisateur d’un site Internet doit pouvoir accepter les conditions générales librement, de manière spécifique et de manière informée[ci]. Par ailleurs, il n’est pas rare que les hébergeurs de sites d’Internet proposent des politiques de vie privée (privacy policy) qui expliquent quelles données sont collectées et leurs finalités de traitements[cii]. Ces règles de politiques de vie privée doivent pouvoir être, également, acceptées de manières libres, spécifique et de manière informée.

Les conditions générales font également objet de l’examen du régime de la clause insolite[ciii]. Ce régime permet d’exclure une clause insolite de l’intégration globale des conditions générales si la clause est subjectivement et objectivement surprenante[civ]. La clause sera considérée subjectivement surprenante lorsque la partie ne s’y attendait pas, et qu’elle n’a pas été rendue attentive à cette clause[cv]. La clause sera considérée objectivement surprenante lorsque la clause est inhabituelle pour le type d’affaire ou ne correspond pas au cadre légal du contrat[cvi]. À propos du traitement des données personnelles, le consentement ne serait pas donné sauf si la personne concernée était attentive à cette clause et qu’elle correspond au cadre du contrat prévu[cvii]. En d’autres mots, le consentement doit être éclairé sur la finalité du traitement de données ainsi que sur le type de données[cviii].

Par exemple, le Tribunal administratif fédéral a critiqué que les clauses dans les conditions de générales de l’assurance Helsana ne respectaient pas les conditions à l’information adéquate sur le consentement[cix]. En effet, la clause rédigée était formulée de manière large et ne contenait aucune limitation quant à la finalité du traitement[cx]. Pour le Tribunal administratif fédéral, Helsana tentait d’obtenir un consentement au-delà de la finalité nécessaire. Il était difficile pour les clients d’Helsana de se retrouver parmi les clauses d’utilisation et politique de confidentialité. Les clients d’Helsana ne comprenaient donc à quels traitements ils consentaient.

Au sujet du consentement sur la transmission des données personnelles sensibles, un arrêt du Tribunal administratif fédéral a jugé que « la personne concernée doit avoir été dûment informée du traitement de données auquel elle consent et elle doit avoir exprimé librement sa volonté d’accepter le traitement de données »[cxi]. Le Tribunal administratif fédéral a précisé, en outre, que la personne concernée doit savoir quelles sont les conséquences négatives dans l’octroi de son consentement[cxii]. C’est-à-dire que la personne concernée doit évaluer les principaux risques et conséquences dans le cas des données personnelles sensibles. Ce n’est pas le cas lorsque la personne concernée doit accepter un abonnement semestriel ou annuel avec le prélèvement de ses empreintes digitales (données sensibles)[cxiii].

Par ailleurs, si le consentement est prévu dans une des clauses des conditions générales, un contrôle de la clause sera nécessaire au regard de l’art. 8 de la loi fédérale du 19 décembre 1986 contre la concurrence déloyale (LCD)[cxiv]. L’examen de l’art. 8 LCD ne s’applique qu’aux relations avec des consommateurs[cxv]. Selon cette disposition, la clause litigieuse ne doit pas, d’abord, être contraire aux règles de la bonne foi ; ensuite, la clause ne doit pas être en déséquilibre notable et injustifié entre les droits et les obligations des parties contrat au détriment du consommateur[cxvi]. Les critères de l’art. 8 LCD sont les mêmes de l’art. 3 de la Directive 1993/13/CEE du Conseil du 5 avril 1993 concernant les clauses abusives dans les contrats conclus avec les consommateurs, JO n°L 95 du 21 avril 1993, p. 29[cxvii]. Les solutions juridiques d’autres juridictions de l’Union Européenne sont sources d’inspirations pour interpréter l’art. 8 LCD[cxviii].

En s’inscrivant sur Flickr, il est prévu qu’en cliquant sur le bouton « j’accepte » nous acceptons d’être lié par les conditions générales d’utilisation[cxix]. Les conditions générales sont claires, concrètes, faciles d’accès, reconnaissables et non trompeuses. En matière de protection des données, les conditions générales prévoient que l’utilisateur autorise à recueillir, utiliser, communiquer et traiter des informations le concernant conformément à leur politique relative à la protection des données[cxx]. Ce dernier document précise quelles données sont collectées et comment les données sont utilisées dans le cadre de l’offre de Flickr[cxxi]. Un addendum relatif au traitement de données personnelles est également mentionné dans les conditions générales[cxxii]. L’addendum restreint Flickr de retenir, utiliser ou divulguer les données personnelles de l’utilisateur en dehors du cadre de l’addendum prévu[cxxiii]. Ainsi, nous considérons que le consentement de traiter les photographies des utilisateurs par Flickr est suffisamment éclairé et encadré. Le consentement prévu dans les conditions n’est pas contraire à la bonne foi et n’est pas disproportionné et injustifié entre les droits et les obligations découlant du contrat conclu avec le consommateur.

Il est à noter qu’aucune référence sur l’utilisation des photos, pour entraîner une IA n’est mentionnée dans les conditions générales, dans la politique de confidentialité et dans l’addendum sur la protection des données personnelles. Concernant le téléchargement des photos sur Flickr par d’autres utilisateurs, les conditions générales d’utilisation prévoient une interdiction de téléchargement du contenu sur Flickr sous réserve d’une mise à disposition par les utilisateurs[cxxiv]. Autrement dit, il est possible de collecter des photographies sur Flickr à condition que les utilisateurs de Flickr donnent leurs accords. La fonctionnalité « partage de photos » permet de choisir qui peut voir, télécharger ou interagir avec le contenu mis à disposition par les utilisateurs[cxxv]. Enfin, il est expressément mentionné que toute utilisation d’élément autres que celle que prévues est interdite[cxxvi]. En définitive, les conditions d’utilisation, sa politique de confidentialité et son addendum sur la protection des données ne prévoient pas un accord sur le téléchargement sur les photographies sauf si les utilisateurs de Flickr l’autorisent.

c. Les licences Creative Commons

Le droit d’auteur protège les auteurs d’œuvres littéraires et artistiques en vertu de l’art. 1 al. 1 let. a de la loi fédérale du 9 octobre 1992 sur le droit d’auteurs et les droits voisins (LDA)[cxxvii]. Pour bénéficier de cette protection, il faut que l’œuvre soit une création de l’esprit, littéraire ou artistique, possède un caractère individuel » (art. 2 al. 1 LDA). Auparavant, le critère de l’individualité imposait que la photographie sorte de la banalité afin qu’elle soit protégée[cxxviii]. Aujourd’hui, grâce à l’art. 2 ch. 3bis LDA, les photographiques dépourvues de caractère individuel sont protégées.

De surcroit, les utilisateurs de Flickr sont bien protégés par les droits d’auteur. Flickr précise bien que lorsque nous publions une photo, nous sommes toujours titulaires des droits d’auteurs[cxxix].

Flickr donne aux utilisateurs la possibilité d’octroyer divers types de licences que l’on appelle Creative Commons sur leurs photos protégées[cxxx]. Grâce aux licences Creative Commons, d’autres utilisateurs de Flickr peuvent télécharger les photos, les utiliser ou encore les modifier. Les Creative Commons ont, avant tout, pour but de faciliter la transmission et l’accès des droits d’auteurs sur internet[cxxxi].

En droit suisse, les licences Creative Commons correspondent à un contrat de licence soit un contrat innomé sui generis[cxxxii]. Le donneur de licence octroie au preneur de licence une cession de l’usage et de la jouissance d’un droit ou d’un bien immatériel contre le paiement d’une redevance[cxxxiii]. Dans le cas des Creative Commons, l’auteur de la photo renonce à faire valoir certains droits d’auteur, mais pas à leur titularité[cxxxiv]. En outre, l’auteur a le choix entre plusieurs types de Creative Commons qui va du domaine public (CC BY) à une restriction de modification des photos (CC BY-ND). Certaines licences Creative Commons non-commerciaux ou domaines publics n’exigent pas une redevance.

La conclusion d’un contrat de licence Creative Commons se fait par les règles générales du Code des obligations (CO)[cxxxv]. Le contrat est conclu lorsque les parties ont réciproquement et d’une manière concordante manifestée leur volonté (art. 1 al. 1 CO)[cxxxvi]. Les licences Creative Commons sont rédigées de manières standardisées, préformulées et destinées à un nombre indéterminé de personnes. Ce qui correspond à des conditions générales que le preneur de licence accepte[cxxxvii]. En utilisant l’œuvre sous licence Creative Commons, le preneur de licences accepte les conditions d’utilisation de la photo.

Par ailleurs, lors d’une conclusion d’un contrat de Creative Commons, les parties doivent respecter les normes impératives de l’ordre juridique suisse, en particulier le droit de la personnalité[cxxxviii]. Les droits de la personnalité dont le droit à l’image sont, en principe, incessibles. L’art. 27 al. 2 CC prévoit, en effet, que « nul ne peut aliéner sa liberté, ni s’en interdira l’usage dans une mesure contraire aux lois ou aux mœurs ». Il est, toutefois, possible de céder dans un contrat de licence son image pour une campagne de publicité par exemple[cxxxix]. Pour ce faire, le consentement de la personne concernée doit être éclairé et déterminé afin de satisfaire l’art. 27 al. 2 CC. Autrement dit, le consentement obtenu à la cession de l’image doit être interprété avec rigueur et en faveur de la protection de la personnalité du donneur de licence[cxl]. Le consentement ne vaut que pour une finalité déterminée. Dans le contexte contractuel, cela veut dire que le contenu et la portée de l’image cédée par le donneur doivent être encadrés de manière précise. Sinon, le preneur de licence aurait carte blanche sur le droit à l’image du donneur de licence[cxli].

Nvidia a collecté des photographies avec des licences « Creative Commons BY 2.0 », « Creative Commons BY-NC 2.0 », « Public Domain Mark 1.0 », « Public Domaine CC0 1.0 » et « US Government Works »[cxlii]. Les licences Creative Commons types licences permettent l’utilisation libre, la redistribution et l’adaptation pour des usages non-commerciaux. En collectant les photographies sur Flickr et avec des licences, nous pouvons considérer que Nvidia a conclu un contrat avec les auteurs des photos.

Il est exact que les types des Creative Commons téléchargés permettent de copier, distribuer, de remixer, de transformer et créer à partir du matériel pour toute utilisation[cxliii]. Ce qui laisse à Nvidia une marge importante sur les traitements des photos. En revanche, le consentement des personnes sur les photos n’est pas respecté. Les clauses préformulées des Creative Commons notent que la licence « ne vous donne pas toutes les permissions nécessaires pour votre utilisation ». Le droit à l’image est mentionné comme susceptible d’être limité par les donneurs de licences en vertu d’autres normes légales[cxliv]. Ce qui veut dire que Nvidia, en plus de respecter les conditions des licences, devait obtenir le consentement explicite et éclairé des personnes sur les photos. Or, il ressort que Nvidia n’a pas obtenu le consentement des personnes sur les photos. Les personnes concernées en accordant que leurs photos soient réutilisables par d’autres, ne savent pas que leurs visages serviront à alimenter une IA générant de faux visages. Ainsi, à défaut d’avoir obtenu un consentement avec une finalité déterminée, Nvidia ne peut pas invoquer le consentement comme motif justificatif.

3. Les photographies librement accessibles sur Flickr et motifs justificatifs (art. 31 LPD)

L’art. 30 al. 3 LPD prévoit qu’il n’y a pas d’atteinte lorsque la personne concernée a rendu les données personnelles librement accessibles à tous à chacun et qu’elle ne s’est pas expressément opposée au traitement. La présomption de l’art. 30 al. 3 LPD revient à l’auteur du traitement[cxlv]. Cette hypothèse se réalisera, par exemple, lorsque la personne concernée a publié des photographies sur Internet[cxlvi]. Si l’art. 30 al. 3 LPD est admis alors le responsable de traitement n’a pas besoin de respecter les principes généraux de la LPD et respecter son devoir d’information (art. 19 LPD)[cxlvii].

Pour notre cas d’espèce, Nvidia pourrait invoquer cette disposition puisque les personnes concernées ont mis à disposition les photos librement sur Internet et ne se sont pas opposées à ce que leurs photos soient modifiées. Toutefois, nous doutons que l’art. 30 al. 3 LPD suffit pour justifier les traitements de Nvidia. Comme nous l’avons vu, les personnes concernées ne savent probablement pas que leurs visages sont utilisés pour entraîner une IA. Cela ne correspond pas à un comportement volontaire, même à travers des licences Creative Commons.

L’analyse d’un motif justificatif pour Nvidia (art. 31 LPD) ne pourra se faire par un intérêt privé ou public puisque nous ne l’avons pas retenu dans notre examen sur la proportionnalité[cxlviii]. Comme nous l’avons démontré, le consentement des personnes concernées ne sera pas non plus valable en raison du type de traitement de données par Nvidia.

D. Les droits des personnes concernées

1. Les titulaires des droits (art. 5 let. b LPD)

a. Les personnes physiques

Selon l’art. 5 let. b LPD, seules les personnes physiques dont les données personnelles font l’objet d’un traitement sont protégés par LPD[cxlix]. Les mots « personnes physiques » renvoient au début et à la fin de la personnalité (art. 31 al. 1 CC). Cette dernière disposition prévoit que l’acquisition de la personnalité commence par la naissance accomplie de l’enfant vivant et elle se termine avec la mort. Ainsi, seules des personnes vivantes sont protégées par la LPD[cl].

b. Les personnes décédées

Parmi les 70’000 photos utilisées par Nvidia, des visages de personnes décédés sont reconnaissables. Par exemple, une photo de Desmond Tutu, célèbre archevêque sud-africain, décédé en 2021 figure dans la base de données (cf. infra, Annexe 7)[cli]. Il est aussi probable que des personnes moins connues soient décédées avant ou après l’acquisition des images par Nvidia. L’utilisation de visages de personnes décédées par le StyleGAN pose des interrogations juridiques importantes sur les droits des personnes décédés ainsi que le droit des proches de personnes décédées.

Actuellement, la nouvelle LPD ne protège plus les données personnelles de personnes décédées[clii]. L’ancien art. 1 al. 7 de l’ancienne Ordonnance sur la loi fédérale sur la protection des données LPD conférait « un droit à la consultation des données d’une personne décédée lorsque le requérant justifie d’un intérêt à la consultation et qu’aucun intérêt prépondérant de proches de la personne décédée ou de tiers ne s’y oppose. Un intérêt est établi en cas de proche parentée ou de mariage avec la personne décédée[cliii] ». Dans un premier temps, le législateur avait considéré, dans sa révision de la LPD, d’intégrer un droit des proches, héritiers ou exécuteur testamentaire à restreindre ou interdire l’accès des données aux tiers (art. 16 al. 3 P-LPD)[cliv]. Toutefois, la Commission des institutions politiques n’a pas retenu cette disposition au motif que les lois successorales prévoient déjà un transfert des droits aux défunts et aux héritiers[clv]. Cette lacune de la loi est critiquable car les proches des personnes décédés devront avoir la qualité d’héritiers pour retirer les droits de la personne défunte à l’accès de ses données ou à l’anonymisation. Ci-dessous, nous traiterons du droit de la personnalité patrimonial afin que les proches et héritiers puissent faire valoir leurs droits (cf. infra, II C et III).

2. Droit d’accès des personnes concernées (art. 25 LPD)

Selon l’art. 25 al. 1 LPD, toute personne peut demander au responsable de traitement si des données personnelles la concernant sont traitées. Le responsable a une obligation de répondre à la demande d’accès ainsi que de fournir des renseignements complets, exacts et compréhensibles. L’art. 25 al. 2 LPD prévoit, non exhaustivement, des informations devant être communiquées à la personne concernée dans le cadre d’une demande de droit d’accès. Dans le cadre de notre analyse du traitement effectué par Nvidia, nous traiterons les éléments plus pertinents de l’art. 25 al. 2 LPD.

Sans aucunes restrictions, Nvidia a mis à disposition toutes les informations nécessaires au traitement des photos ainsi que l’accès aux photographies utilisé pour le StyleGAN. Globalement, la publication des travaux et la page GitHub « Flickr-Faces-HQ dataset » fournissent toutes les informations nécessaires. L’identité et les coordonnées du responsable traitement (art. 25 al. 2 let. a LPD) ne sont autres que Nvidia. Les informations aux données personnelles traitées en tant que telles (art. 25 al. 2 let. b LPD) sont aussi accessibles. La page GitHub du projet StyleGAN met à disposition un site Internet permettant de découvrir si nos photos ont été collectées. La finalité du traitement des photos est connue puisque les recherches publiées de Nvidia expliquent concrètement que les photographies collectées servent à entraîner une IA (art. 25 al. 2 let. c LPD). Les informations sur l’origine des données sont communiquées en indiquant que les photos collectées proviennent de la plateforme Flickr (art. 25 al. 2 let. e LPD).

La durée de conservation des données ou les critères de conservation ne sont pas mentionnés dans les travaux de Nvidia (art. 25 al. 2 let. d LPD). Comme nous l’avons vu (cf. supra, I C 1). Cela indique explicitement que Nvidia n’a pas agi en conformité avec les principes du devoir de transparence et d’information.

Nous n’examinons pas la restriction d’un droit d’accès prévu à l’art. 26 LPD puisque Nvidia a donné accès à toutes les photographies collectées sur Flickr[clvi]. Enfin, en l’absence de dispositions spéciales de la LPD, nous traiterons du droit d’accès en matière successorale ci-dessous (C.f infra)[clvii].

3. Droit à l’oubli (effacement) des personnes concernées

Le droit à l’oubli ou à l’effacement est défini comme : « reconnaître le droit de faire supprimer une information, dans la version en ligne du média, dans les archives électroniques de celui-ci ou dans celles d’une banque de données professionnelles »[clviii].

Le droit à l’oubli n’est pas une disposition explicitement consacrée dans la LPD[clix]. Le Conseil fédéral et le Préposé disent toutefois que ce droit peut être déduit du principe de la proportionnalité (art. 6 al. 2 LPD)[clx]. Dès qu’un responsable de traitement se rend compte qu’il n’est plus nécessaire ou proportionné de traiter des données, il doit cesser le traitement et, si possible d’effacer ou supprimer la donnée[clxi]. Cependant, le droit à l’oubli n’est pas absolu. Il est nécessaire de vérifier s’il n’existe pas d’intérêt prépondérant entre la personne concernée et celui du responsable de traitement[clxii].

L’art. 32 al. 2 let. c et al. 4 LPD permet à la personne concernée de demander l’effacement ou la destruction des données dans le cadre d’une prétention en droit civil (art. 28a al. 2 CC).

La jurisprudence a su concrétiser un droit à l’oubli. Dans l’ATF 122 III 449, le Tribunal fédéral a jugé qu’une condamnation pénale concerne la sphère publique et suscite donc un intérêt public. Mais au bout d’une période de dix ans, cet intérêt public prépondérant s’estompe pour retomber dans la sphère privée de la personne concernée[clxiii]. Toutefois, il est important de souligner que le droit à l’oubli n’est pas absolu[clxiv]. En effet, lorsque les faits sont véridiques, il existe un intérêt du public à être informé. Ainsi, il est nécessaire de délimiter la sphère publique et sphère privée de la personne concernée dans la pesée d’intérêt.

Une décision de la Cour de Justice de l’Union européenne, analogue au droit à l’oubli en Suisse, a jugé qu’un droit à l’oubli se justifiait lors d’une recherche sur le moteur de recherche Google[clxv]. En vertu des arts 7 et 8 de la Charte de l’Union Européenne du 7 décembre 2000, la personne concernée a droit à ce que sa vie privée soit respectée. Toutefois, la pesée dépend de la nature de l’information, de la vie privée et de l’intérêt public. Dans le cas d’espèce, l’ingérence sur la vie privée était forte car le résultat de la recherche concernait une mention de saisie sur la personne concernée et longtemps après les faits[clxvi]. Par ailleurs, selon la Directive 95/46 du Parlement européen et du Conseil, du 24 octobre 1995, relative à la protection des personnes physiques à l’égard du traitement des données à caractère personnel et à la libre circulation de ces données, la personne concernée a un droit à ce que l’information en question relative à sa personne ne soit plus liée à son nom à la suite d’une recherche effectuée sur le moteur.

Les personnes ayant fait l’objet de la collecte par Nvidia n’auront pas besoin d’agir au regard de la LPD. En effet, Nvidia a par sa propre initiative concrétisée le droit à l’oubli des personnes concernées[clxvii]. D’après la section « Privacy » de la page GitHub, les auteurs du StyleGAN se sont engagés à protéger la vie privée des personnes qui ne souhaitent pas que leurs photos soient utilisées. Nvidia indique que les personnes concernées peuvent effectuer les démarches suivantes sur Flickr. Il est possible de : « marquer la photo avec « no_cv » pour indiquer que vous ne souhaitez pas qu’elle soit utilisée pour la recherche en vision par ordinateur ; changer la licence de la photo en None (tous droits réservés) ou toute autre licence Creative Commons avec NoDerivs pour indiquer que vous ne souhaitez pas qu’elle soit redistribuée. Rendre la photo privée, c’est-à-dire qu’elle ne soit visible que par vous et vos amis/famille. Faire retirer la photo de Flickr ». Enfin, il est toujours possible de contacter les chercheurs de Nvidia grâce à un courriel mis à disposition.

Cette façon d’opérer permet de compenser en partie l’atteinte illicite à la personnalité lors de la collecte de données. Nous pouvons aussi considérer que ces options de droit à l’oubli indiquent une bonne volonté de la part de Nvidia.

E. Synthèse

La collecte et la modification des 70’000 photos Flickr afin d’alimenter le StyleGAN ne sont pas conformes à la LPD. Notre analyse a démontré que les photos des utilisateurs Flickr sont des données sensibles car elles peuvent être utilisées pour créer un profil numérique d’une personne et qu’elles renferment des informations délicates sur sa personnalité. Nvidia, en tant que personne privée, est bien la responsable du traitement des photographies. Le fait que le traitement des photos a eu lieu aux États-Unis n’a pas d’importance puisque les photographies ont été capturées en Suisse. Nvidia a violé les principes de légalité, de transparence et de proportionnalité de la LPD lors du traitement des photos. Elle ne pourra pas se prévaloir d’un motif justificatif sur la base d’un intérêt public ou privé ou légal. De plus, ni les conditions générales de Flickr ni les conditions de licence Creative Commons ne donnent un consentement exprès des utilisateurs Flickr sur le traitement de leurs photos par une IA. Enfin, Nvidia a su mettre en place un droit d’accès sur les photos collectées ainsi qu’un droit à l’effacement des données. Les utilisateurs pourront faire valoir leurs droits. Il reste, toutefois, une question concernant les photographies de personnes décédées.

II. La protection des visages en droit de la personnalité

A. Le droit de la personnalité en général

La personnalité est définie comme « l’ensemble des biens ou valeurs qui appartiennent à une personne du seul fait de son existence » ou encore « l’ensemble des qualités individuelles qui composent une personne qui la distingue des autres personnes [clxviii]». Les biens de la personnalité protègent toutes les facettes de la vie d’une personne. C’est le cas notamment de son droit à l’image, de son droit à la vie privée ainsi qu’un droit des proches à sauvegarder la mémoire d’une personne décédée.

Consacrée à l’art. 28 al. 1 CC, une atteinte à un droit de la personnalité doit être comprise dans un sens objectif et avec une intensité suffisante [clxix]. C’est-à-dire que l’atteinte doit dépasser le seuil de tolérance que l’on peut attendre de toute personne vivant en société[clxx]. Si une atteinte est admise, une présomption d’illicéité existe. Elle est encore susceptible d’être justifiée par un consentement de la victime, un intérêt prépondérant privé ou public ou encore une loi (art. 28 al. 2 CC).

Le droit de la personnalité et la LPD peuvent être invoqués cumulativement. C’est-à-dire que l’art. 32 al. 2 LPD renvoie explicitement aux articles 28 ss CC pour que le demandeur requière : l’interdiction d’un traitement déterminé de données personnelles (art. 32 al. 2 let. a LPD) ; l’interdiction d’une communication déterminée de données personnelles à des tiers ; ou l’effacement ou la destruction de données personnelles (art. 32 al. 2 let. c LPD). Cette complémentarité permet donc d’élargir les possibilités d’action du droit de la personnalité des personnes concernées. Il est à noter, toutefois, que l’art. 32 al. 2 LPD ne mentionne pas un droit d’accès aux données personnelles comme le fait l’art. 25 LPD.

En ce qui concerne les atteintes à la personnalité effectuées par Nvidia, nous nous concentrons sur le droit à l’image, le droit à la vie privée et le droit des proches de personnes décédées. Nous avons déjà conclu que Nvidia n’était pas au bénéfice d’un motif justificatif au sens de la LPD qui se recoupe à nouveau avec l’art. 28 al. 2 CC. La présente partie démontre que la jurisprudence sur le droit de la personnalité protège suffisamment la personnalité des personnes concernées contre les traitements effectués par Nvidia.

B. Le droit à l’image

Les IA génératrices de faux visages comme le StyeGAN ou le Deepfake présentent un risque sur notre droit à l’image[clxxi]. En effet, il est aisé pour quiconque, de télécharger une photographie d’une personne, de créer un Deepfakeavec l’IA et de diffuser l’image sur Internet. C’est d’ailleurs ce qu’a fait un conseiller national à l’encontre d’une politicienne lors de la campagne d’élection fédérale de 2023[clxxii].

Fort heureusement, même si la technologie est nouvelle et accessible à tous, le Tribunal fédéral a concrétisé un droit à la protection de notre image. Selon lui, « le droit à l’image fait partie des droits de la personnalité, protégés par l’art. 28 CC ; chacun a le droit de s’opposer à l’utilisation de son image par des tiers sans consentement »[clxxiii]. Dans l’arrêt Google Street View, le Tribunal fédéral a défini que : « le droit à sa propre image est un droit d’autodétermination qui protège contre toute représentation illicite de l’identité visuelle personnelle. Il comprend deux droits distincts dans leur contenu : d’une part, un droit de défense dirigé contre tout enregistrement photographique et cinématographique réalisé dans un but de découverte et d’identification de la personne ; d’autre part, un droit à l’autodétermination de la personne relatif à la publication de son image, en particulier son portrait, et à l’utilisation de son image dans une publicité commerciale ou politique »[clxxiv]. Ainsi, une prise de vue par un véhicule Google constituerait une atteinte à son droit à l’image dès lors que la personne est reconnaissable[clxxv]. Concernant les photographies, le Tribunal fédéral retient qu’il y a une atteinte à sa propre image dès qu’une personne est photographiée sans son accord ou qu’une photographie est publiée sans son autorisation[clxxvi].

Est-ce que le droit à l’image protège notre visage lorsqu’il est modifié ou réutilisé en dehors du cadre prévu ? Oui, c’est le cas[clxxvii]. En effet, plusieurs cas de jurisprudences se sont penchés sur la question des photomontages et de l’atteinte à la personnalité. Dans une première affaire, un photomontage a présenté les têtes de trois cadres de Novartis placés sur trois corps huileux et nu[clxxviii]. Ce photomontage a été fait dans le cadre d’une initiative politique visant à instaurer des salaires maximaux pour les dirigeants d’entreprises. Il a été publié dans divers articles de presse et sur Internet. Le Tribunal fédéral a retenu des atteintes à la personnalité des cadres concernés. C’est-à-dire que les cadres sont présentés dans des positions désavantageuses (corps nus graisseux et postures évoquant un sentiment de honte)[clxxix]. Même s’il s’agit d’un photomontage, cette représentation rabaissait l’image professionnelle et sociale des cadres. Un lecteur moyen d’un journal ressentirait également une certaine excessivité. Toutefois, le Tribunal fédéral a admis que cette atteinte était justifiée (art. 28 al. 2 CC) en raison d’un intérêt public prépondérant[clxxx]. Dans un cas plus ancien, une ancienne employée d’un journal a subi un montage photographique de la part de son ancien employeur[clxxxi]. Son visage, prénom et nom étaient publiés dans un journal avec un numéro de téléphone rose imaginaire à des fins satyriques. D’une part, le Tribunal fédéral a constaté que l’image de l’ancienne employée était doublement dénaturée par un découpage et extraite de son contexte initial à l’insu de l’intéressée[clxxxii]. D’autre part, faire passer l’ancienne employée pour une prostituée, porte atteinte à sa considération dans son entourage et lecteurs du journal. Ces éléments ont été jugés comme une atteinte à la personnalité au sens de l’art. 28 al. 1 CC de l’ancienne employée. Aucun motif justificatif n’a été retenu[clxxxiii].

Ainsi, par raisonnement analogique, même si l’IA affaiblit le contrôle sur notre propre image, la jurisprudence sur le droit à l’image offre des protections suffisantes. Comme le cas des photomontages, l’utilisation, la modification et la diffusion de nos visages constituent une atteinte à notre droit à l’image. Le fait que le StyleGAN de Nvidia ne crée une forme d’expression faciale comme le Deepfake ne change pas que les personnes concernées ont un droit à ce que leurs visages ne soient ni modifié, ni traité dans un autre cadre prévu.

C. Les proches de personnes décédées

Tel que nous l’avons vu, il est fort probable que des images de personnes décédées figurent dans la base de données du StyleGAN. Les moyens d’action en faveur de la personne décédée sont limités. D’une part, la LPD ne confère pas des moyens d’action pour retirer les photos de ces personnes en leurs noms. D’autre part, le droit suisse ne donne pas plus de qualité au défunt pour agir, concernant une atteinte à sa personnalité puisque sa personnalité est éteinte par sa mort (art. 31 CC)[clxxxiv].

Seuls les proches peuvent faire valoir leur droit de sentiment de piété filiale à l’égard du défunt[clxxxv]. C’est ce qu’on appelle autrement la protection du souvenir. Les proches pourront agir en leur propre nom et non en celui du défunt[clxxxvi]. L’image du défunt sera donc indirectement protégée dès le moment où la personnalité affective des proches se trouve aussi atteinte par le dénigrement de la personne décédée[clxxxvii]. À noter que le droit des proches est subsidiaire à la volonté exercée de son vivant[clxxxviii]. La notion de proche est aussi restreinte car une hiérarchie des proches a été établie à l’art. 378 CC[clxxxix]. Subsidiairement, la jurisprudence définit les proches comme des personnes faisant ménage commun avec la personne décédée et entretenant avec elle des relations personnelles[cxc].

La jurisprudence a déjà traité de la problématique des images de personnes décédées et du respect de la piété filiale. L’arrêt Hodler concernait l’exposition d’un tableau représentant le peintre Hodler sur son lit de mort[cxci]. La veuve du peintre n’avait pas autorisé l’exposition du tableau et a plaidé que son sentiment de piété était atteint par l’exposition du tableau non autorisée. Le Tribunal fédéral a retenu que « La protection de l’art. 28 CC s’étend aussi aux sentiments intimes qui comprennent le sentiment de piété envers des proches décédés, les souvenirs d’événements communs importants, de circonstances particulières qui attachent les êtres les uns aux autres et qui s’incorporent en quelque sorte à notre personnalité »[cxcii]. Il a aussi relevé que le sentiment de la veuve de Hodler est touché profondément par l’œuvre montrant Hodler immédiatement après son décès. Garder ce souvenir dans un cadre privé est un désir respectable. Dans une autre affaire, le Tribunal fédéral a exprimé que les proches d’une jeune fille décédée ont un droit à ce que le cadavre et indirectement l’image de cette dernière ne soient pas profanés après sa mort. Il est pertinent de protéger les souvenirs communs importants que les proches ont envers la personne décédée. Dans une dernière affaire de nature pénale, le Tribunal fédéral a examiné la question des photographies d’un défunt sans autorisation par la famille et de leurs impressions pour en faire des tee-shirts. En plus de retenir une infraction à pour violation du domaine secret ou du domaine privé au moyen d’un appareil de prise de vue (art. 179quater CP), le Tribunal fédéral a mentionné que les proches pouvaient faire valoir leurs droits de piétés en vertu de l’art. 28 CC[cxciii]. Ce qui confirme en ce sens une protection de l’image du défunt.

Est-ce que les proches peuvent agir en leur nom par rapport aux photos collectées par Nvidia ? Nous donnons une réponse positive. Comme l’a dit la jurisprudence Hodler, nous arguons que l’utilisations d’images de proches pour entraîner une IA affecte le sentiment de piété envers des proches décédés. Même si cette jurisprudence concerne la représentation du peintre mort, nous pensons que cela s’appliquerait également lorsqu’une IA utilise des photos pour générer des faux visages, voir des Deepfake. Les photos d’une personne décédée sont pour les proches intimes et permettent de garder en mémoire les moments partagés avec la personne décédée[cxciv]. Par analogie, nous imaginons bien qu’il sera difficile pour les proches de laisser des portraits d’une personne chère circuler sur Internet et être exploité abusivement. Par ailleurs, comme c’est le cas du sort du cadavre, les proches doivent pouvoir garder un certain contrôle sur l’image de la personne décédée. Après l’ensevelissement du corps, les portraits sont un moyen de garder la mémoire du défunt. Les souvenirs et les événements que véhiculent les photos doivent être intimes et respectés pour les proches.

III. Le sort des photos de personnes décédées en droit successoral

A. L’héritage des photographies en droit des successions

L’art. 560 al. 1 CC prévoit que ce sont les héritiers qui acquièrent de plein droit l’universalité de la succession dès que celle-ci est ouverte. Cette disposition de nature impérative instaure le principe universel de la succession, principe que ni le défunt et ni un tiers ne peuvent déroger[cxcv]. Les objets de la succession sont les créances et actions, les droits de propriété et autres droits réels, les biens qui se trouvaient en la possession du défunt et enfin les dettes (art. 560 al. 2 CC). Il existe, toutefois, des exceptions sur la transmissibilité (art. 560 al. 2 in fine CC).

Le Tribunal fédéral considère que la succession doit être comprise largement : « les rapports juridiques relevant du droit des obligations, les droits de propriété intellectuelle, certains rapports patrimoniaux et non patrimoniaux du droit de la famille, des expectatives des droits d’options et des situations juridiques »[cxcvi]. Ce qui inclut dans une certaine mesure la transmissibilité des données numériques du défunt aux héritiers[cxcvii]. Dans cette perspective, les photos protégées par les droits d’auteurs au sens de l’art. 2 al. 3 bis LDA et les licences Creative Commons de Flickr devraient être comprises comme biens transmissibles (art. 560 al. 2 CC)[cxcviii].

Toutefois, la succession n’inclut pas la transmission des biens du droit de la personnalité dont font partie les données personnelles[cxcix]. Les droits de la personnalité font partie, en effet, des droits strictement personnels qui sont des droits subjectifs privés ; ils concernent des attributs essentiels de la personne[cc]. Lorsqu’une personne décède, ses droits de sa personnalité s’éteignent avec celle-ci. Les données personnelles du défunt comme ses biens ne sont donc pas incluent dans l’art. 560 al. 2 CC et la conception large du Tribunal fédéral.

En ce sens, un droit d’accès aux données personnelles du défunt ne sera pas possible par voie successorale. Pour les mêmes raisons évoquées ci-dessus, le droit d’accès est de nature strictement personnelle ; il ne peut pas être transmis aux héritiers légaux[cci]. Ces derniers devront invoquer alors leurs propres droits en matière de droit successoral (déterminer la capacité de discernement du de cujus), de responsabilité civile (vérifier une erreur médicale) ou en droit de la personnalité (suppression d’un compte de réseaux sociaux)[ccii].

Cette absence de transmissibilité des données personnelles pose des problèmes importants aux héritiers. D’abord, le de cujus devra s’assurer que ses héritiers auront accès à ses données personnelles après son décès[cciii]. Par exemple, la transmission des noms d’utilisateurs et des mots de passe sont concernés. En pratique, cette transmission est découragée pour des raisons de sécurité des données personnelles. De plus, notre société n’a pas encore pris conscience de l’importance de ce type de communication dans le cadre d’une succession. Ce sont aussi les plateformes internet qui décident des modalités contractuelles sur la transmission des données personnelles[cciv]. Les héritiers devront, ainsi, au cas par cas vérifier les conditions générales de chaque plateforme afin d’accéder aux données ou demander la suppression du compte.

En se référant à notre cas d’usage, ce serait en principe les héritiers de l’utilisateur Flickr décédé qui hériteront des photographies et donc du compte. Revendiquer les photographies sur la base des droits d’auteur offre une solution satisfaisante. Concrètement, nous avons établi que les photographies sur Flickr sont protégées grâce à la loi sur les droits d’auteur et les licences Creative Commons. De ce fait, les normes successorales et la jurisprudence garantissent expressément la transmission des droits d’auteur dont les photographies. Les héritiers de l’utilisateur Flickr défunt pourront agir sur la base de leurs propres droits.

En revanche, les héritiers légaux n’ont pas un droit d’accès sur les données du compte Flickr et d’empêcher la collecte, par le compte la collecte de photo pour entraîner le StyleGAN. Malgré cette absence de normes légales, nous pouvons rementionner que Nvidia a mis en libre accès une page de recherche permettant d’identifier si nos photos ont été collectées[ccv]. Il sera, dès lors possible d’écrire directement à Nvidia afin de retirer les photos collectées.

B. Le cadre contractuel sur la transmissibilité du compte